Comment estimer le changement climatique ?

La variabilité du système climatique à l’échelle planétaire et à l’échelle du siècle résulte des interactions entre ses diverses composantes comme l’atmosphère, l’océan, la biosphère, la banquise (indiquées en noir). Il varie aussi sous l’effet de processus externes (en rouge), qu’ils soient naturels (rayonnement solaire, volcanisme) ou liés aux activités humaines (émissions de gaz et de particules, occupation des sols).

Infographie : Pour la Science

L’idée de ce qu’on appelle aujourd’hui « l’effet de serre » résulte d’une lente maturation. Le mathématicien Joseph Fourier est l’un des premiers à avoir étudié, au début du XIXe siècle, les phénomènes physiques qui en sont à l’origine. Il est l’auteur d’une distinction entre la « chaleur lumineuse » qui nous vient du soleil (rayonnement visible), et la « chaleur obscure » émise par la surface terrestre (rayonnement infrarouge), la seconde traversant plus difficilement l’atmosphère que la première. Dans la seconde moitié du XIXe siècle, le Britannique John Tyndall découvre le rôle particulier de gaz en très faible quantité dans l’atmosphère, tels que la vapeur d’eau et le gaz carbonique, qui représentent respectivement 0,25 et 0,06 pour cent environ de la masse atmosphérique. Ces gaz absorbent peu le rayonnement visible, mais absorbent beaucoup plus les infrarouges. Ils « piègent » de ce fait le rayonnement qui monte de la surface terrestre, puis réémettent ce rayonnement dans toutes les directions de l’espace. La surface terrestre reçoit ainsi un surcroît d’énergie radiative qui contribue à son réchauffement. Ce mécanisme naturel réchauffe notre planète d’environ 34 °C. En 1896, le Suédois Svante Arrhenius estime cependant que la combustion du charbon pourrait avoir un effet additionnel sur la température de la planète. Son calcul conduit à un réchauffement de 3,4 °C, correspondant à l’augmentation de 50 pour cent de la concentration du CO2 atmosphérique, mais en 3 000 ans ! Cependant les observations faites depuis 1957 à Mauna Loa, à Hawaii, ont montré que la concentration du CO2 atmosphérique augmentait bien plus rapidement que les travaux précurseurs d’Arrhenius ne le laissaient supposer.

Dans le même temps, les premières analyses de longues séries d’observations de la température signalent une tendance au réchauffement sur le siècle, même si celui-ci n’est ni régulier ni uniforme. Alertée par la coïncidence de ces deux constats et par les premiers résultats de simulations de l’impact climatique qu’aurait un doublement de la concentration du CO2 atmosphérique, la communauté scientifique a créé en 1988 un groupe de travail nommé GIEC (Groupe intergouvernemental d’experts sur l’évolution du climat, ou IPCC en anglais) sous l’égide de l’Organisation météorologique mondiale et du Programme des Nations unies pour l’environnement. Le premier objectif de ce groupe est d’évaluer l’information scientifique et socio-économique sur le changement climatique, ses impacts et les différentes options pour l’atténuer ou s’y adapter. Détecte-t-on dans les observations un signal de changement climatique non explicable par la seule variabilité interne du climat ? Si oui, attribue-t-on ce signal à une cause naturelle ou à une cause anthropique, à savoir la modification de la composition chimique de l’atmosphère liée aux activités humaines ? Que deviendra le climat dans les décennies et siècles à venir, compte tenu de l’évolution démographique et économique susceptible d’entraîner une augmentation accrue des émissions de gaz à effet de serre ?

Pour répondre à ces questions, la modélisation est indispensable : c’est en effet le seul outil à même de considérer les mécanismes mis en jeu dans toute leur complexité. Habituellement, le climat est défini à partir des propriétés statistiques (moyennes, extrêmes, etc.), des paramètres météorologiques (température, précipitations, ensoleillement, etc.), pour une période couvrant une trentaine d’années. Il varie toutefois sur une large gamme d’échelles de temps, couvrant aussi bien plusieurs semaines que des milliers d’années. Cette variabilité s’explique en partie par des interactions entre les composantes du système climatique : l’atmosphère, l’hydrosphère (océans, lacs, rivières), la cryosphère (banquise, surfaces enneigées, calottes polaires), la biosphère (continentale et marine) et la partie supérieure de la lithosphère, concernée par le cycle de l’eau. Cette variabilité résulte aussi de forçages externes au système, qu’ils soient naturels (comme la variabilité solaire ou l’activité volcanique) ou anthropiques (liés à l’activité humaine).

Les planètes de notre système solaire sont en équilibre énergétique, c’est-à-dire qu’elles reçoivent de l’énergie du soleil sous la forme de rayonnement UV et en émettent vers l’espace sous la forme de rayonnement infrarouge. Cet échange radiatif permet de maintenir l’équilibre énergétique de la planète. On appelle « forçage radiatif » tout phénomène influant sur le comportement du rayonnement émis ou reçu par la Terre (ou toute autre planète du système solaire).

- Quand l’énergie émise par la Terre (sous la forme d’infrarouge) est interceptée pour être renvoyée vers les couches basses de l’atmosphère au lieu d’être renvoyée vers l’espace, on dit que le forçage radiatif est positif. Ce forçage positif provoque une augmentation de chaleur au niveau de la surface terrestre et de la basse atmosphère.

- Quand l’énergie envoyée par le soleil (sous la forme d’UV) est renvoyée vers l’espace avant d’avoir réchauffé les couches basses de l’atmosphère, on dit que le forçage radiatif est négatif. Ce forçage provoque un refroidissement au niveau de la surface terrestre et de la basse atmosphère.

Les gaz à effet de serre ont un forçage radiatif positif. Quant aux aérosols, leur forçage varie en fonction de leur type et de leur couleur mais globalement, on peut dire qu’il est légèrement négatif pour l’ensemble des aérosols.

La circulation générale

Un simple modèle analytique, basé sur des équations de bilan d’énergie, suffit à déterminer une température d’équilibre de la planète pour un forçage solaire donné, ou à calculer l’évolution de la température planétaire en réponse à une augmentation de la concentration des gaz à effet de serre.

Dans certains modèles simples, la température moyenne à la surface de la planète est déduite d’un bilan énergétique de la terre (atmosphère, continents et océans) dans lequel la variation de l’énergie interne est égale à la différence entre l’énergie solaire absorbée et l’énergie perdue par rayonnement infrarouge. Dans le cas le plus général, ce bilan conduit à une équation faisant intervenir les dérivées temporelles de la température. À l’équilibre, ces dérivées s’annulent et l’équation obtenue permet de calculer la variation de température liée à une variation donnée de la concentration des gaz à effet de serre. Cette équation peut par exemple prendre la forme suivante (modèle de Dutton, 1995) :

où T est la température de surface, Γ un paramètre d’amplification des changements de température liés aux rétroactions agissant dans le système climatique (causées en particulier par les variations de la couverture de neige et de glace, des nuages, du contenu en vapeur d’eau de l’atmosphère…), Fs le rayonnement infrarouge montant en surface et G le forçage radiatif par effet de serre calculé comme la différence entre le rayonnement infrarouge montant en surface et le rayonnement infrarouge montant au sommet de l’atmosphère. Une variation ΔΧ de la concentration initiale Χ0 des gaz à effet de serre est responsable d’une variation ΔG de G qui peut être estimée par l’équation suivante :

Pour une température moyenne de 288 K (environ 15°C), un rayonnement infrarouge émis en surface de 390W/m2, et Γ = 3,09 (ajusté sur les résultats des modèles complexes décrits dans l’article), le calcul montre que l’effet d’un doublement de la concentration des gaz à effet de serre est un réchauffement d’environ 2,5°C.

Mais il ne permet ni d’évaluer la sensibilité climatique, définie par le réchauffement planétaire induit, à l’équilibre, par un doublement de la concentration en gaz carbonique atmosphérique, ni de déterminer les distributions géographiques des changements climatiques et leurs impacts dans différents secteurs socio-économiques (agriculture, hydrologie, santé, etc.). Ces paramètres nécessitent la mise au point de modèles plus complexes.

Les modèles climatiques ont progressé en même temps que la puissance des ordinateurs. Sur le premier calculateur programmable existant, le mathématicien John von Neumann a conçu en 1950, avec d’autres scientifiques, un modèle de prévision météorologique. En 1956, Norman Phillips et son équipe ont développé au Geophysical Fluid Dynamics Laboratory, à Princeton, aux États-Unis, le premier modèle que l’on peut qualifier de climatique, car il a permis la simulation de la variabilité de l’atmosphère de l’hémisphère Nord sur une période de 31 jours. Ce modèle, dit de circulation générale (MCG), ne présentait aucune différence conceptuelle avec ses prédécesseurs appliqués à la prévision météorologique.

Plus tard, vers la fin des années soixante, sont apparus les premiers modèles couplant l’évolution de l’atmosphère et celle de l’océan. L’utilisation de ce type de modèle se généralisa, notamment pour les besoins des études du changement climatique. Les océans jouent en effet un rôle essentiel dans la distribution géographique et le temps de mise à l’équilibre du système climatique. Cela est dû à la fois à leur grande inertie thermique comparée à celle de l’atmosphère, et à la lenteur des processus de mélange vertical et de transport des eaux de surface vers l’océan profond. Pour donner un ordre d’idée, si la basse atmosphère retrouve son équilibre une semaine après un apport énergétique, il faudra par contre 30 à 40 ans à la partie supérieure de l’océan, et un millier d’années à l’ensemble des océans pour y revenir. Les climatologues ont progressivement introduit dans leurs modèles de nouveaux phénomènes. Aujourd’hui, ils considèrent l’atmosphère, les océans, les sols et la végétation, les banquises, les aérosols sulfatés, et dans certains cas l’hydrologie continentale, le cycle du carbone incluant la biosphère et les écosystèmes marins, ou encore l’ozone stratosphérique…

Source : Wart Dark / Wikipédia

Évolution de la modélisation du système climatique à l’échelle mondiale. Outre l’atmosphère, on tient compte progressivement d’un plus grand nombre de composantes, telles que les surfaces terrestres, les océans et les banquises. Les derniers exercices de simulations pour le GIEC correspondent à la quatrième étape de développement (atmosphère surface terrestre océan et banquise aérosols sulfatés).

Source : GIEC

Nous nous focaliserons ici sur les modèles de circulations atmosphériques et océaniques. Ces deux composantes partagent un ensemble commun de cinq équations d’évolution qui s’appliquent aux variables des deux fluides (densité, vent ou courant, température) et qui sont issues des lois de la mécanique des fluides et de la thermodynamique. La première est l’équation de conservation de la masse, les trois suivantes résultent de l’équation de conservation de la quantité de mouvement (ou relation fondamentale de la dynamique), appliquée aux trois composantes de la vitesse des particules fluides, et la dernière est l’équation de conservation de l’énergie (ou premier principe de la thermodynamique). Par ailleurs, les lois de la thermodynamique permettent de relier les variables au travers d’une équation d’état propre à chaque milieu. À ces équations s’ajoutent, pour l’atmosphère, l’équation de conservation de la masse de l’eau contenue dans l’atmosphère et, pour les océans, l’équation de conservation du sel.

Discrétisation et approximations

L’atmosphère est divisée en un grand nombre de boîtes élémentaires, correspondant chacune à des éléments homogènes tels que le vent, la température, la pression, la nébulosité, la hauteur de précipitation, etc.

Source : Météo-France

À moins de simplifications importantes, on ne peut résoudre analytiquement ces équations, si bien que l’on recourt à des techniques d’analyse numérique et à la puissance des ordinateurs. Le principe de base consiste à découper l’atmosphère ou l’océan en boîtes élémentaires, de 200 à 300 kilomètres sur l’horizontale et de quelques mètres à quelques centaines de mètres sur la verticale. Le temps est lui-même décomposé en pas élémentaires, d’une durée de 15 à 30 minutes. On doit déterminer les moyennes des variables sur les boîtes élémentaires, à des pas de temps successifs. Pour ce faire, on « discrétise » les équations en remplaçant les calculs de dérivées partielles par rapport à l’espace ou au temps, par des accroissements, ou différences finies, des variables de la grille spatio-temporelle. Pour l’atmosphère, une autre méthode de résolution, limitée au traitement des termes de transports horizontaux, consiste à décomposer les variables en sommes de fonctions aux propriétés mathématiques intéressantes sur la sphère. Cette méthode est dite spectrale pour la distinguer de la méthode utilisant exclusivement la technique des points de grille décrite plus haut.

Qu’ils soient spectraux ou en points de grille, les modèles subissent des contraintes liées au traitement numérique des équations. Par exemple, on est obligé de choisir un découpage dans le temps d’autant plus fin que la résolution (la dimension des boîtes) est petite. Si le découpage temporel n’est pas assez fin, des instabilités numériques se développent et, en quelques pas de temps, conduisent à une solution irréaliste. Lewis Fry Richardson fit les frais de cette instabilité lorsque, le premier, il tenta de résoudre une forme simplifiée des équations de l’atmosphère, bien avant de disposer de la puissance de calcul des ordinateurs. Après plusieurs années de travail, il publia en 1922 les résultats d’un calcul manuel de l’évolution de l’atmosphère sur une période de six heures, effectué sur le principe d’un découpage de l’espace et du temps. Son calcul était faux en raison d’un pas de temps trop long. Plus précisément, la condition de stabilité du schéma numérique dénommée critère CFL (d’après les noms des mathématiciens Richard Courant, Theodor Friedrichs et Hans Lewy) stipule que le pas de temps maximal possible est proportionnel à la dimension de la grille spatiale et inversement proportionnel à la vitesse maximale des ondes représentées par le modèle. Voilà pourquoi les modèles atmosphériques et océaniques négligent les ondes acoustiques les plus rapides, de peu d’impact sur la dynamique atmosphérique ou océanique. Dans les premiers programmes de prévision numérique, une autre famille d’ondes rapides était filtrée : les ondes d’inertie-gravité, dues à la combinaison de la gravité et de la rotation terrestre. C’est ce qu’on appelle l’approximation quasi géostrophique. Les modèles actuels n’emploient plus cette approximation, pour mieux représenter l’effet du relief sur les écoulements.

Une autre approximation, restée en vigueur dans les modèles actuels de circulation générale, aboutit à limiter les valeurs des vitesses verticales, et donc à réduire les risques d’instabilité. Cette approximation dite quasi hydrostatique consiste à supposer l’équilibre à chaque instant entre la force de gravité et la poussée d’Archimède, ce qui revient à négliger les accélérations verticales. Cette hypothèse est valide à condition de se situer à des échelles spatiales voisines ou supérieures à la dizaine de kilomètres, qui ne permettent pas de reproduire le détail des circulations induites par le processus de convection. Une autre contrainte concerne la représentation des processus à une échelle inférieure à la dimension des boîtes élémentaires. Ce peuvent être des processus de transport, tels que des ondes d’inertie-gravité, des tourbillons maritimes, larges de quelques dizaines de kilomètres, ou encore, à une échelle bien plus petite, les turbulences dans la basse atmosphère et à la surface de l’océan. Ce peuvent être aussi des processus qui engendrent des sources ou des puits de chaleur à prendre en compte dans l’équation de conservation de l’énergie : rayonnement, convection, formation des nuages et des précipitations.

Dans un premier temps, on évalue l’effet de ces processus « sous-maille » sur les variables de la grille spatio-temporelle de calcul. On représente ensuite ces processus par des paramètres, que l’on détermine à partir de connaissances théoriques (sur le transfert radiatif, sur la turbulence, etc.) et à partir de méthodes empiriques. Quelle que soit la dimension de la maille spatiale, la paramétrisation de processus d’échelle plus petite reste une nécessité. Une des principales difficultés de la modélisation est de définir les ensembles de paramétrisations les mieux adaptés aux échelles résolues par le modèle.

La validation des modèles

Dès qu’une nouvelle version est élaborée et avant qu’elle ne soit utilisée pour simuler les changements climatiques futurs, elle est soumise à une batterie de tests d’évaluation, qui consistent à confronter ses résultats aux observations. Pour ce faire, on intègre le modèle sur quelques décennies en séparant ses différentes composantes ou en les couplant. L’un des tout premiers tests est la vérification de l’équilibre radiatif calculé au sommet de l’atmosphère et la comparaison des différentes composantes radiatives (dans les domaines visible et infrarouge) à des données issues de satellites. Les moyennes des variables atmosphériques ou océaniques calculées sur la période simulée sont aussi comparées aux moyennes des données fournies par les réseaux d’observations in situ ou satellitaires.

Anomalies de températures (en °C) à la surface des océans lors de l’épisode El Niño en 1997. Source : Wikipédia

Des analyses plus poussées permettent de vérifier si le modèle reproduit les principales caractéristiques des variations connues, telles que les épisodes El Niño, les moussons ou les oscillations de pression aux moyennes latitudes. On tente aussi de reproduire une chronologie en contraignant le modèle par des conditions aux limites observées : par exemple, on contraint un modèle atmosphérique par les températures océaniques observées mois après mois. Dès lors, on peut analyser finement la variabilité interannuelle, comme le contraste entre le climat de l’année 1987, marquée par un épisode El Niño important, et l’année 1988, qui a connu un épisode froid dans le Pacifique Est-équatorial. Par ailleurs, au niveau international, on compare les modèles entre eux et aux mêmes observations. Cela permet de multiplier les analyses et de mieux identifier l’origine des erreurs. Un autre mode de validation consiste à confronter les paramétrisations des processus sous-maille d’un modèle à des données d’observations détaillées, ainsi qu’à des simulations réalisées avec des modèles de plus forte résolution, qui décrivent explicitement ces processus. Il s’agit donc d’une validation locale d’un processus censé avoir un impact significatif sur les variables calculées par le modèle. Les données d’observations sont recueillies aux cours de campagnes de mesures qui réunissent sur un lieu donné et pendant une période de temps limitée des avions instrumentés, des stations de mesures automatiques, des radars, etc. À titre d’exemple, la Campagne internationale AMMA (analyse multidisciplinaire de la mousson africaine) a couvert la saison des pluies de 2006 en Afrique de l’Ouest, et a fourni des données susceptibles d’améliorer la paramétrisation de la convection atmosphérique dans les modèles climatiques.

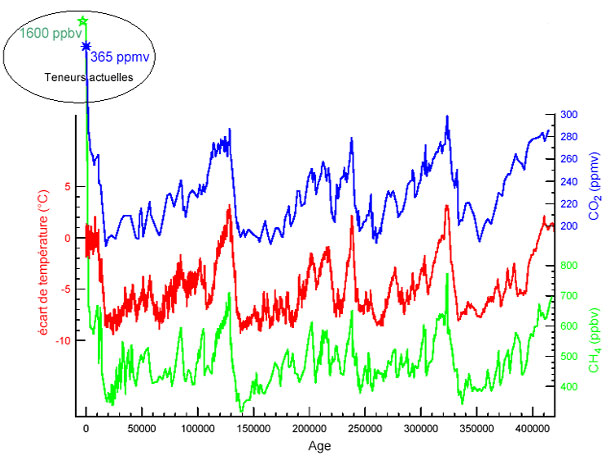

Valider un modèle, c’est aussi tenter d’améliorer le degré de confiance que l’on accorde aux projections faites pour les prochaines décennies ou les siècles à venir. Ce type de validation est à l’étude. Une des pistes suivies consiste à vérifier que le modèle reproduit bien à l’échelle diurne, saisonnière ou interannuelle des mécanismes susceptibles de jouer un rôle important dans le changement climatique. L’effet radiatif des nuages est un tel mécanisme : on vérifie qu’il est bien décrit par comparaison aux données satellitaires. On peut aussi s’assurer que le modèle représente correctement le climat du XXe siècle lorsque les sources naturelles et anthropiques de variabilité climatique sont prises en compte. Enfin, on tente actuellement de simuler les climats passés lointains, comme celui du moyen holocène (il y a environ 6 000 ans) ou celui du dernier maximum glaciaire (il y a environ 21 000 ans), pour confronter les résultats à des données paléoclimatiques, obtenues dans les glaces et les sédiments.

Carottage glaciaire de 3500 m à Vostok (Antarctique)

Source : D’après Petit et al., Nature, V. 399, Juin 1999

Les scénarios de changement climatique

Pour répondre aux questions posées par le changement climatique et ses impacts, le GIEC utilise les modèles du système climatique et des études économiques et démographiques. Ils composent, non pas des prévisions, irréalisables à l’échelle de plusieurs décennies, mais des scénarios d’évolution du climat, supposés couvrir un large éventail d’évolutions possibles.

Source : GIEC, 2001

Dans un premier temps, on élabore des scénarios d’émissions anthropiques des principaux gaz à effet de serre (gaz carbonique, méthane, protoxyde d’azote, etc.) entre 1990 et 2100. On propose aussi des scénarios d’émissions de particules dans l’atmosphère (aérosols sulfatés) dont les conséquences sur le climat sont inverses de celles des gaz à effet de serre : ils sont en effet responsables d’une absorption du rayonnement solaire, de l’augmentation du pouvoir réfléchissant des nuages et de la durée de vie de ces derniers, effets allant dans le sens du refroidissement du climat.

Grâce à des modèles de transport et d’échanges à la surface terrestre, ces scénarios d’émissions sont transformés en scénarios de concentration de gaz à effet de serre et d’aérosols sulfatés dans l’atmosphère. Ces derniers servent alors d’entrée aux modèles du système climatique qui calculent leurs impacts sur le climat. Partant de ces résultats, le GIEC a réalisé en 2001 une synthèse qui évalue le réchauffement climatique entre 1990 et 2100 dans une fourchette de 1,4 °C à 5,8 °C. C’est beaucoup plus que ce qu’avait estimé Arrhenius, principalement parce que ce dernier avait surestimé le pouvoir absorbant du CO2 par les océans. La largeur de la fourchette est due quant à elle aux incertitudes inhérentes à ces évaluations, d’une part, les différences entre les scénarios d’émission de gaz et de particules utilisés dans les projections climatiques et, d’autre part, les incertitudes de la modélisation climatique elle-même. On classe ces dernières en trois catégories. Dans la première se trouvent les incertitudes sur les paramètres d’entrée des modèles, dont ceux qui décrivent les processus sous-maille. La deuxième catégorie comporte les incertitudes liées à la conception des modèles, qu’elles proviennent des équations utilisées, du traitement numérique de ces équations ou de la paramétrisation des processus sous-maille. On y inclut aussi l’absence de représentations de certains processus, négligés ou mal connus. Enfin, une troisième source d’incertitude est le caractère en partie chaotique du climat qui se traduit par le fait qu’un même modèle partant de deux états climatiques proches calcule deux évolutions climatiques notablement différentes.

Les dernières simulations

Un nouvel exercice de simulation du climat futur, coordonné au niveau international, a été réalisé dans le cadre de la préparation du prochain rapport du GIEC, à paraître courant 2007. Une quinzaine de groupes, mettant en œuvre une vingtaine de modèles différents, ont simulé le climat du XXe et du XXIe siècles suivant les scénarios recommandés par le GIEC. Pour la première fois, on a considéré des scénarios de stabilisation de la concentration des gaz à effet de serre à partir de 2100, préfigurant les conséquences du protocole de Kyoto et de ses suites éventuelles. Deux groupes français de recherches climatiques — le Centre national de recherches météorologiques (CNRM) de Météo-France et l’Institut Pierre Simon Laplace (IPSL) du CNRS et du CEA — ont participé à cet exercice.

|

|

|

|

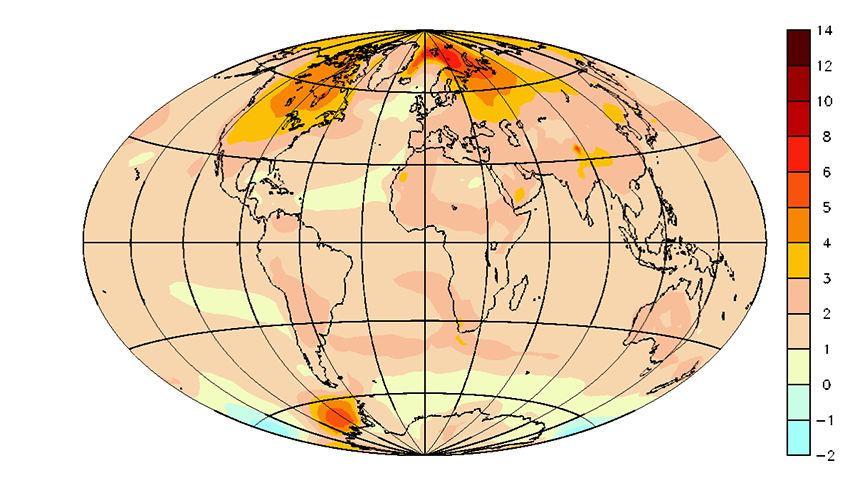

Cartes des changements de températures entre la période 2000-2009 et la période 2090-2099, simulés par deux groupes de recherche différents (CNRM de Météo-France en haut et IPSL du CNRS et du CEA en bas), à partir de deux scénarios d’augmentation des émissions de gaz à effet de serre, proposés par le GIEC. Le premier scénario (noté A à gauche) est un scénario d’émissions faibles, tandis que le second (B à droite), suppose une forte augmentation mais aucun ne prend en compte les mesures liées au protocole de Kyoto et ses suites éventuelles. Dans les deux cas, les températures augmentent considérablement.

Source : IPSL

Malgré les différences entre les modèles utilisés, le réchauffement planétaire moyen calculé est voisin de 4 °C en 2100 pour le scénario le plus pessimiste présenté (scénario B). Les scénarios de stabilisation indiquent que le système climatique continuerait à se réchauffer de 0,5 °C à 0,7 °C entre 2100 et 2300, ce qui souligne l’inertie du système. Les répartitions des changements de température ou de précipitation calculées par les deux modèles sont comparables à très grande échelle spatiale. Cependant les différences sont sensibles à l’échelle d’une région particulière de la planète (par exemple les régions de mousson ou l’Atlantique Nord). Cela montre l’intérêt d’utiliser plusieurs modèles et d’en analyser les résultats de manière combinée pour mieux interpréter l’origine des incertitudes sur les changements climatiques simulés. Les modèles du système climatique ne sont qu’un maillon d’une longue chaîne d’études du changement climatique et de ses impacts socio-économiques. Les progrès de la modélisation du système climatique dans son ensemble sont essentiels pour améliorer notre compréhension des observations récentes, et pour affiner les scénarios d’évolution future. Ces progrès ont permis au GIEC d’être plus affirmatif en 2001 qu’il ne l’était quelques années auparavant concernant l’influence humaine sur le réchauffement climatique des 50 dernières années.

Les voies de progrès de ce type de modélisation sont multiples. Une première voie consiste à introduire dans le modèle des processus dont l’impact sur le changement climatique a été jusque-là négligé ou pour lesquels les connaissances étaient insuffisantes : l’effet des aérosols carbonés, le rôle des processus biologiques dans le cycle du carbone, etc. Le caractère multidisciplinaire de la construction des modèles du système climatique est donc encore appelé à se renforcer. Une deuxième voie de progrès est l’amélioration de la résolution des composantes, en particulier atmosphériques et océaniques, afin de mieux représenter les phénomènes extrêmes. On utilise actuellement des modèles climatiques de plus forte résolution sur des régions d’étendue limitée, pour étudier les impacts régionaux du changement climatique. Une troisième voie devrait consister à élargir l’ensemble des simulations réalisées pour un même scénario afin de mieux prendre en compte les incertitudes de la modélisation. L’objectif est d’affecter une probabilité aux changements climatiques calculés sur les différentes régions de la planète. Il nous faudra pour cela progresser dans la connaissance du fonctionnement du système climatique, et accroître les moyens de calcul alloués à la modélisation.

Quelques éléments de bibliographie vous sont proposés pour en savoir plus sur le changement climatique et sa modélisation.

Sur le changement climatique

- Climate change 2001 : The Scientific Basis, version française (en PDF) ; prochain rapport à paraître courant 2007.

- RealClimate, Climate science from climate scientists (blog sur lequel des scientifiques répondent aux questions du public et des médias).

- Dossier Sagascience sur le climat

- Climat : Comment éviter la surchauffe ?, Dossier Pour la Science, N°54, janvier 2007.

- Jean JOUZEL et Anne DEBROISE, Le climat : jeu dangereux, Dunod, collection « Quai des Sciences », Paris, 2004.

Sur les simulations de changement climatique réalisées en France

- Réchauffement climatique : les nouveaux résultats des modèles français

- Michel ROCHAS et Jean-Pierre JAVELLE, La météorologie. La prévision numérique du temps et du climat, Syros, collection « Comprendre », Paris, 1993.

Une première version de cet article est parue dans le dossier n°52 La modélisation informatique, exploration du réel de la revue Pour la Science, numéro de juillet/septembre 2006.

Newsletter

Le responsable de ce traitement est Inria. En saisissant votre adresse mail, vous consentez à recevoir chaque mois une sélection d'articles et à ce que vos données soient collectées et stockées comme décrit dans notre politique de confidentialité

Niveau de lecture

Aidez-nous à évaluer le niveau de lecture de ce document.

Votre choix a été pris en compte. Merci d'avoir estimé le niveau de ce document !

Serge Planton