Un méta-langage pour la création d’œuvres artistiques collectives

Seule avec loup, navigation chorégraphique 3D interactive des chorégraphes et chercheurs Nicole et Norbert Corsino.

Création présentée du 1er au 26 juin 2006 au Centre Pompidou à Paris, dans le cadre du Festival Agora/Ircam.

Est-ce dénaturer un art que de le lier à un autre ? Cela fait bien des années que la co-création entre artistes suscite de telles interrogations. Dans son Esthétique III, Hegel compare ainsi la musique avec les arts plastiques et la poésie. On retrouve ce même type de questionnement au début du cinéma, dans des écrits assez radicaux comme ceux de Lev Koulechov. Quels sont les ingrédients nécessaires à un film pour qu’il puisse enfin être reconnu comme une forme d’art indépendant et non comme du théâtre filmé ?

Une problématique similaire se pose dans le cadre des œuvres poly-artistiques, qui doivent par nature intégrer du matériau provenant de diverses disciplines artistiques. Et la situation s’aggrave lorsqu’on veut ajouter de l’interactivité…

1. Créer une œuvre collective ?

De nos jours, les œuvres poly-artistiques interactives sont des types d’expression artistique de plus en plus répandus. Les spectateurs sont amenés à y jouer un rôle plus actif, devenant en quelque sorte des specta(c)teurs — spectateurs-acteurs de l’œuvre interactive. Des créations telles que Topologies de l’instant et Seule avec loup des chorégraphes Nicole et Norbert Corsino, Schlag ! de Roland Auzet, Le musée virtuel de la photographie contemporaine de Ahad Yari Rad, ou encore Waves d’Andrea Cera et Hervé Robbe mettent en œuvre ce concept. Toutes ces compositions, qui associent des contributions de différents champs artistiques (composition musicale, chorégraphie, cinéma, vidéo, art plastique…), ont nécessité l’usage d’une grande variété de technologies matérielles et logicielles interconnectées, que ce soit pour le rendu sonore, pour les mondes virtuels interactifs, pour la capture des mouvements, pour de l’animation graphique 2D, etc. Or, malgré cette profusion de technologies, il n’existe aujourd’hui aucun outil, langage ou formalisme pour faciliter la conception de telles œuvres d’art collaboratives.

Comment créer collectivement une œuvre numérique interactive, fruit de la rencontre de plusieurs créations qui restent individuelles, même si elles sont coordonnées ? Cela commence par la définition de la nature de l’interactivité et de ses répercussions sur les différents constituants de l’œuvre. Pour un média classique tel que le cinéma, le processus peut être itératif : on compose la musique sur des images ou on filme à partir du rythme d’un morceau de musique choisi. Par contre, dans le cas d’une œuvre numérique interactive, un contrat doit être établi entre les différents protagonistes de la création. La difficulté réside ensuite dans la pluralité des interactions et des dialogues qui en résultent : dialogues entre artistes, entre artistes et ingénieurs, entre le specta(c)teur et l’œuvre interactive, entre les différents logiciels de supports à la création et à l’exécution, etc.

Pour ouvrir un véritable dialogue entre artistes au sein d’une œuvre collective, il faut disposer d’un vocabulaire commun, complété des langages pratiqués par les artistes. Par ailleurs, du fait de la variabilité et de la non prédictibilité de la performance, les systèmes en œuvre doivent être ouverts et malléables.

Lors du colloque international intitulé « Écritures du temps et de l’interaction », en juin 2006, Wolf Heiniger, l’assistant musical du compositeur suisse Hanspeter Kyburz, a axé son intervention sur le travail de création d’une œuvre commune entre Hanspeter Kyburz et le chorégraphe Emio Greco, intitulée Double points : +. Il a insisté sur la nécessité de créer un dialogue entre artistes venant de différents champs disciplinaires. Dans une co-création, la difficulté réside dans la projection des structures d’un univers artistique donné sur celles d’un ou plusieurs autres univers. Il serait réducteur de choisir une approche maître-esclaves avec un univers, et donc de mettre en avant une discipline artistique, qui piloterait les autres. Une composition naît de l’interaction entre les différents médias.

Dans Double points : + par exemple, deux systèmes fonctionnent en parallèle, le système de captation des gestes du danseur et le système de déclenchement des structures musicales. Le danseur improvise selon son propre vocabulaire gestuel et sa connaissance préalable des modes d’interaction de son geste avec la musique. La captation de son geste module de façon continue, selon le premier système, des sons synthétisés en temps réel. Le geste capté est reconnu par le second système qui agit pour paramétrer et déclencher les objets musicaux. Il a été décidé que la syntaxe de contrôle ne serait pas corrélée à la syntaxe chorégraphique. On a donc introduit un humain dans la boucle qui suit la partition, pour récupérer les paramètres chorégraphiques et déclencher les processus musicaux.

Dans les projets poly-artistiques actuels, à l’issue d’une phase de discussion et d’échange dans laquelle chacun s’exprime avec son propre bagage culturel et son vocabulaire métier, il est nécessaire de faire intervenir un ingénieur ou un technicien. C’est avec sa propre interprétation et à l’aide de protocoles encore trop rudimentaires et pauvres en expressivité, que celui-ci va définir le contenu de ce qui transitera dans les tuyaux de communication entre les logiciels ou les bibliothèques spécialisées.

L’établissement des communications entre composants matériels et logiciels reste donc complexe et exige la définition d’un langage spécifique pour chaque œuvre. Ce langage repose souvent sur l’utilisation d’un protocole très répandu dans le domaine artistique, OSC (Open Sound Control), qui permet de faire communiquer ensemble des ordinateurs, des synthétiseurs et autres périphériques multimédias. Intégré dans de nombreux logiciels, ce protocole fonctionne suivant un mécanisme client/serveur, en transmettant des messages dont les données sont très rudimentaires. Bien que très utilisé, le protocole OSC reste malgré tout très limitatif du point de vue du langage de communication entre applications. Il ne peut manipuler que des notions très basiques (entiers, réels, chaînes de caractères, date) et est donc insuffisant pour constituer un véritable langage de création de l’interactivité dans une œuvre. En effet, les implémentations permettant de l’utiliser dans les différents logiciels, quand elles existent, sont de qualité trop variable. Pour utiliser ce protocole comme support d’un langage de plus haut niveau, l’ensemble des logiciels devraient disposer d’une grammaire commune.

La prise de conscience de cette problématique a été au cœur de la conception de l’œuvre Seule avec loup, des chorégraphes Nicole et Norbert Corsino.

L’exemple de Seule avec loup

Installation présentée à l’espace muséal Villeneuve Bargemon, à Marseille, en juillet 2007.

Réalisée en collaboration avec l’INRIA et l’Ircam (Institut de Recherche pour la Coordination Acoustique et Musique), Seule avec loup est une œuvre composée d’un dispositif image avec trois vues perpendiculaires d’une même scène (gauche, frontale et droite) mais dépliées sur un écran plat de 12 mètres de long par 3 mètres de haut. Perpendiculairement à ce mur d’image, un dispositif sonore, comprenant 6 panneaux de Wave Field Synthesis (WFS), forme une fenêtre de 9 mètres de long par 40 cm de haut, centré à une hauteur moyenne d’oreille à 1,60 m du sol. La WFS est un procédé de spatialisation sonore procédant par propagation d’ondes sonores à l’intérieur d’un plan idéalement situé à hauteur d’oreille qui fournit, quelle que soit la position dans la zone d’écoute, de façon très précise la position des sources sonores, qu’elles soient statiques ou en mouvement. Les patchs musicaux de chaque séquence sont composés à l’aide du logiciel de rendu sonore temps-réel Max MSP en fonction des possibilités de la WFS et du logiciel de spatialisation sonore développé par l’Ircam.

Afin de compléter le dispositif et de rendre l’œuvre interactive, un laser à balayage est positionné à l’angle entre les deux murs. Son utilisation permet de délimiter très précisément la position des personnes dans l’espace. Ici, on a restreint la capture à la géométrie de la zone interactive : deux bandes en L, l’une devant la WFS et l’autre devant l’écran visuel. Ce dessin en L permet de laisser libre un carré pour les specta(c)teurs. Une application développée par l’INRIA reçoit les données laser, filtre celles se produisant dans la zone d’interaction, gère le déroulement temporel des séquences chorégraphiques et envoie les événements détectés dans la zone d’interactivité (position et vitesse du specta(c)teur) aux deux logiciels gérant le rendu visuel et le rendu sonore. Dans cette œuvre, les communications entre composants logiciels sont réalisées à l’aide du protocole OSC.

Illustration des différentes communications entre composants logiciels via le protocole OSC.

Engagés dans cette expérience, les mêmes partenaires ont lancé le projet de recherche ConceptMove, qui s’est donné pour objectif de concevoir un méta-langage adapté à la création d’œuvres poly-artistiques intégrant au moins une partie numérique et interactive, ce méta-langage devant être capable de faire dialoguer ensemble de façon générique et à un haut niveau différents logiciels. De mars 2006 à octobre 2007, ce projet, coordonné par l’équipe-projet BUNRAKU de l’INRIA Rennes-Bretagne Atlantique, a rassemblé l’équipe Acoustique des Salles de l’Ircam et la compagnie Danse 34 Productions des chorégraphes Nicole et Norbert Corsino.

2. Concevoir un méta-langage

Pour réussir à concevoir un méta-langage adapté à la création d’œuvres pluri-artistiques, le projet ConceptMove a défini quatre sous-projets à réaliser sur une période de 18 mois : recueillir les besoins des utilisateurs ; spécifier et développer le méta-langage ; faire évoluer les logiciels des partenaires pour la prise en compte du méta-langage ; et enfin, valider le méta-langage par l’expérience et en fonction des retours d’usages.

Identifier les besoins

Afin de définir précisément leurs besoins, il semblait logique de questionner les utilisateurs de ces logiciels dans un contexte artistique. De juin à octobre 2006, une enquête a donc été réalisée auprès des membres du forum Ircam.

Rédigé en français et en anglais, le questionnaire s’est donné pour ambition de recueillir les attentes, les limitations, les avis et les réalisations des différents utilisateurs des logiciels ciblés. La cinquantaine de réponses collectées révèlent que ces usagers s’intéressent majoritairement à une approche artistique, et ce pour des types d’application relativement différents. Une des préoccupations concerne le manque de standard pour organiser la communication. Certaines personnes soulèvent le problème de l’échange de données entre deux logiciels dont les structures sont différentes, regrettant que le travail de conceptualisation de cet échange soit à leur charge. Ce problème d’interfaçage ne semble pas résolu par les langages de programmation existant, il est même insoluble dans certains cas. Il faut également faire face aux problèmes de licences et d’interopérabilité entre différentes plate-formes, ou encore aux temps de prise en main des différents logiciels.

Une deuxième question portait sur l’expressivité disponible avec l’existant. Pour certains artistes, il apparait que les limitations techniques entretiennent justement la créativité et l’expressivité, l’auteur dans ce cas s’adapte aux limites qui lui sont imposées par la technique, l’expressivité se développant aussi avec des limites. Pour d’autres en revanche, l’expressivité préexiste à l’œuvre, et donc la notion d’interface entre l’artiste et la machine devient primordiale lors de la création, nécessitant à ce titre d’être sans cesse améliorée, pour parvenir à une meilleure communication et à une relation plus directe entre la pensée et le résultat. Un exemple donné est de pouvoir lier différents paramètres d’objets de manière intrinsèque, et indépendamment du temps.

D’autres utilisateurs insistent sur la diversité culturelle des personnes impliquées dans une création donnée, et évoquent les problèmes de communication qui en résultent. On retrouve chez beaucoup une méthodologie à base d’essai-erreur, le schéma de communication se faisant sur la base d’allers-retours entre l’artistique et le technique, qui se nourrissent au final des contraintes de l’un et de l’autre. Ce schéma est effectivement souvent décrit comme enrichissant pour l’œuvre.

Les différents utilisateurs ayant répondu à ce questionnaire sont également sensibles à l’accessibilité d’un tel méta-langage via des licences ouvertes. L’aspect communautaire de l’open source est mis en avant pour la réutilisabilité des objets développés par la communauté, mais aussi pour les avantages qu’il apporte au niveau de la documentation. Le manque de documentation est en effet un problème récurrent dont beaucoup se plaignent. Ils souhaiteraient par ailleurs avoir la possibilité de communiquer via des forums, et éventuellement des séances de présentation.

En résumé, les utilisateurs attendent du méta-langage qu’il soit facile d’utilisation, notamment pour un certain nombre de fonctionnalités de base, et qu’il simplifie les problèmes de portabilité entre différentes plate-formes. Tous souhaitent un méta-langage à la fois souple et complexe, extensible et vraiment pluridisciplinaire.

Adapter un méta-langage

Après avoir analysé les freins à la création d’œuvres poly-artistiques interactives, il fallait proposer un méta-langage permettant de répondre à un certain nombre de problèmes soulevés. Même si l’approche choisie n’est pas adaptée à toutes les situations, elle propose néanmoins aux divers artistes un outil pour formaliser une langue d’échange commune.

Ce méta-langage a été conçu dans le but de faciliter la réalisation d’œuvres poly-artistiques interactives de plusieurs manières : premièrement, le processus de communication doit être aussi transparent que possible pour les concepteurs ; deuxièmement, les artistes doivent continuer à utiliser leurs outils classiques, tout en intégrant des flux de communication de et vers le monde extérieur. L’évolution majeure concerne la proposition de conceptualisation d’univers symboliques partagés au sein desquels les artistes vont pouvoir expliciter les relations existant entre leurs univers artistiques propres.

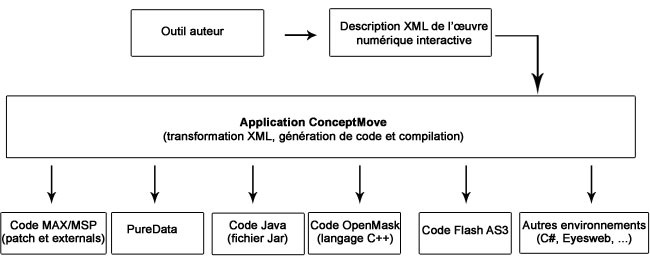

Ce langage, un dialecte d’XML, permet de décrire les éléments d’une œuvre, leurs relations spatiales, temporelles et symboliques au sein d’un formalisme unifié, tout en décrivant pour chaque élément dans quel univers il prendra corps. Un mécanisme de génération de code permet de créer au sein des différents logiciels cibles de l’œuvre la structure de son interface vers le monde extérieur et notamment avec le moteur d’exécution chargé de maintenir la cohérence au cours de l’interaction entre le(s) spectacteur(s) et l’œuvre interactive.

Dès que la description générale du morceau est accomplie avec le métalangage, en incluant la spécification des différentes interactions et contraintes temporelles, c’est le moment de choisir quel environnement matériel/logiciel ou quel langage de programmation les différentes personnes impliquées ont le désir d’utiliser. Comme la description XML sera la source de différents plug-ins au sein d’un ensemble de logiciels (actuellement Max/MSP, Pure Data, Listenspace, OpenMASK, Java), il n’y a en théorie aucune limitation dans le nombre de logiciels qu’un utilisateur peut utiliser. Des développements futurs pourraient ainsi considérer des logiciels comme OpenMusic, Flash et Eyesweb. Cette architecture permet aussi de communiquer avec des matériels existants, à partir du moment où ils disposent d’une communication en OSC.

Aperçu du processus de transformation.

À partir d’information d’adresses IP et de ports, le générateur de code va générer des interfaces bas niveau pour chaque environnement cible désiré. Les interfaces seront ensuite utilisées à un haut niveau dans cet environnement. Par exemple, un développeur Max/MSP sera capable d’établir une communication avec une application java, tout simplement en utilisant ces objets classiques send et receive. Cette partie, gérant la communication, repose sur un standard existant, WSDL, qui permet de décrire la manière dont une application communique avec le reste du monde.

Illustration du code généré dans différents environnements logiciels.

L’usage de contraintes temporelles permet d’établir des relations hiérarchiques complexes entre les objets temporels. Ainsi, le générateur de code disposera des informations nécessaires à la création du moteur d’exécution de l’œuvre, c’est-à-dire d’une application capable de gérer l’ordonnancement en temps-réel des éléments, en fonction d’événements internes ou produits par le ou les specta(c)teurs. Cependant, les demandes de modification ne seront pas prises en compte si elles sont incompatibles avec le scénario écrit de l’œuvre, car il reste la référence principale.

L’idée maîtresse est de commencer par décrire les œuvres poly-artistiques interactives de la façon la plus générique possible, sans tenir compte des différents logiciels, matériels et environnements qui seront utilisés pour les réaliser concrètement. Ensuite, le canevas de l’œuvre est généré automatiquement et chacun peut ainsi travailler sur sa partie en utilisant ses outils et logiciels préférés.

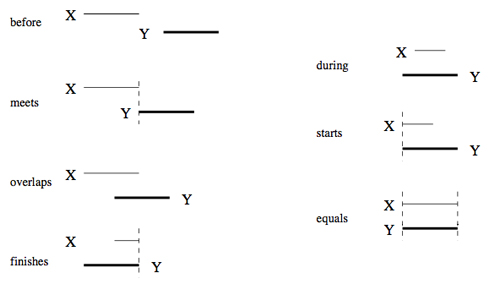

Plusieurs mondes peuvent coexister au sein d’une œuvre à la discrétion des auteurs : par exemple le monde de l’interaction, le monde musical et sonore, le monde chorégraphique, ou encore le monde symbolique. Un monde est composé d’objets de deux types, des capsules et des nucleus, et est régi par des relations. Le nucleus est l’élément atomique de chaque univers. Il peut s’agir d’une interface vers un objet géré par un processus externe, et qui dispose de paramètres et de fonctions propres, mais il peut s’agir aussi d’un élément qui n’a d’existence que symbolique au sein du méta-langage. Une capsule est un espace spatio-temporel clos constitué d’un ensemble de nucleus et d’autres capsules. Les nucleus et capsules contenus dans une même capsule ont une durée de vie qui est implicitement limitée à celle de la capsule mère. Tous ces objets sont liés entre eux par des relations logiques et spatio-temporelles. Concernant les relations temporelles, nous proposons l’usage des relations d’Allen entre les intervalles correspondant aux durées de vie des capsules et nucleus. Nous proposons aussi l’usage de relations spécifiques apparues comme particulièrement importantes dans l’univers musical : Mutex (exclusion mutuelle), Alternate (alternance entre motifs) et Interlace (entrelacement de motifs).

Les relations d’Allen entre deux événements X et Y (le temps s’écoulant de gauche à droite).

La logique d’Allen est une logique temporelle qui permet de caractériser l’ensemble des treize relations possibles entre deux intervalles de temps. Son usage sous forme d’un ensemble de relations conjonctives et disjonctives permet de caractériser une situation temporelle plus ou moins bien définie et qui peut nécessiter d’explorer l’ensemble des solutions possibles (impossible dans le cas général, car cela fait partie des problèmes non traitables en temps polynomial).

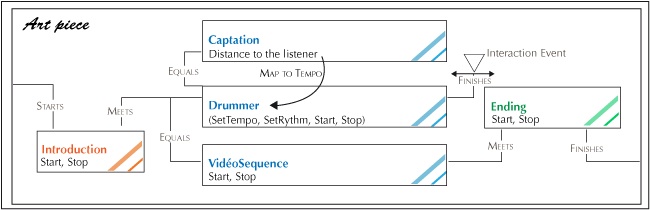

Esquisse simple d’une œuvre interactive en utilisant les relations d’Allen.

Le schéma ci-dessus présente un exemple de structure dans laquelle les éléments ont été formalisés sous la forme d’entités temporelles liées entre elles par des relations temporelles décrites en utilisant la logique d’Allen. Dans cet exemple, l’œuvre est composée de six objets temporels (incluant l’œuvre elle-même) et d’un certain nombre de relations temporelles établies entre les objets temporels. Quand le morceau commence, l’introduction est immédiatement commencée et suivie tout de suite par la section centrale composée des activités parallèles de captation, de jeu de percussions (Drummer) et de génération de vidéo (VideoSequence), liées entre elles par des relations temporelles d’égalité. Au cours de cette période, le module de captation transmet au module de percussion des événements décrivant les positions successives de l’auditeur, celui-ci les liant à des variations de tempo. La partie centrale finit exactement quand l’événement d’interaction attendu se produit. Cela cause le déclenchement de l’élément suivant (Ending) qui finit le morceau.

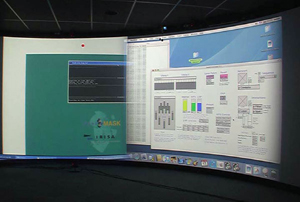

Test de l’interactivité entre l’utilisateur et la musique effectué en septembre 2007 au cours d’une seconde version de Seule avec loup.

Ainsi, il est possible de concevoir une œuvre mais aussi d’en faire un prototype, les différents éléments utilisés étant simples à reconfigurer. La figure ci-dessus illustre un travail sur l’interactivité entre le spectateur et le rendu sonore spatialisé à l’intérieur des séquences de Seule avec loup. Le matériau est identique à celui de l’œuvre, mais le test est effectué dans une salle de réalité virtuelle dans laquelle l’écran devient courbe, avec du son 5.1. Par ailleurs, l’interactivité du specta(c)teur est effectuée non pas avec le laser mais à l’aide d’un flystick du système de réalité augmentée AR Toolkit. Même s’il ne s’agit pas des conditions réelles de démonstration, cela offre néanmoins la possibilité de travailler sur l’interactivité sans avoir à disposer d’un espace grandeur réelle très rarement à disposition des artistes au moment de la création.

Pour conclure

Le projet ConceptMove a permis de démontrer la faisabilité de l’approche basée sur le modèle. Depuis la fin du projet, l’équipe BUNRAKU multiplie les expériences. Elle a travaillé notamment avec d’autres artistes sur une œuvre interactive présentée à la biennale d’art contemporain de Rennes mais par manque de temps, les chercheurs n’ont pas pu tester le méta-langage qu’ils avaient développé sur cette création. Par ailleurs, ils collaborent aujourd’hui avec d’autres sur un projet de lieu permettant d’allier formation pluridisciplinaire, recherche, création, démonstration et animation. Ils sont aussi en discussion avec l’École des Beaux-Arts pour prolonger ensemble ce travail et le confronter à des travaux d’artistes ou d’apprentis-artistes dans le cadre d’ateliers ou de projets croisés d’étudiants.

Néanmoins, pour progresser dans ces projets, les chercheurs ont encore quelques obstacles à surmonter. L’outil auteur actuellement disponible, pour des contraintes de coût de développement n’est utilisable que par des informaticiens et aucunement par des artistes seuls. Pour pouvoir mettre le méta-langage développé à l’épreuve de projets artistiques, les scientifiques doivent donc travailler à une version distribuable (code durci et documentation détaillée), ainsi qu’à un éditeur convivial. D’autre part, il conviendra aussi d’étendre la panoplie des relations spatio-temporelles disponibles au sein du méta-langage. En conclusion, de nombreuses perspectives qui semblent très prometteuses…

Durcir le code, cela signifie tout simplement vérifier le programme et faire qu’il soit fiable, c’est-à-dire qu’il fasse bien, dans tous les cas de figure, ce qu’il est censé faire. Autrement dit, le faire passer du stade de prototype au stade de produit.

- Lev Koulechov. L’art du cinéma et autres écrits. Ecrits (1917-1934). Editions l’Age d’Homme, Lausanne, Suisse, 1994.

- Colloque international intitulé « Écritures du temps et de l’interaction » organisé par Hugues Vinet (Ircam) et Stéphane Donikian (Irisa), dans le contexte des rencontres Résonances 2006 consacrées aux thèmes du geste et de l’interaction. L’objet de ce colloque était de questionner le renouvellement des concepts techniques du temps et de l’interaction à l’oeuvre dans différentes formes artistiques et audiovisuelles.

- Jean-Louis Boissier, La relation comme forme (l’interactivité en art), édité par le Musée d’art moderne et contemporain (Mamco), Genève, Suisse, 2004.

Niveau de lecture

Aidez-nous à évaluer le niveau de lecture de ce document.

Votre choix a été pris en compte. Merci d'avoir estimé le niveau de ce document !